как понять что ai надежен?

тест на умение сказать “это чушь”

большинство тестов ai измеряют то, что модель знает. но, работая с искусственным интеллектом, есть еще один крайне важный фактор — умеет ли модель остановиться, когда вопрос сам по себе не имеет смысла.

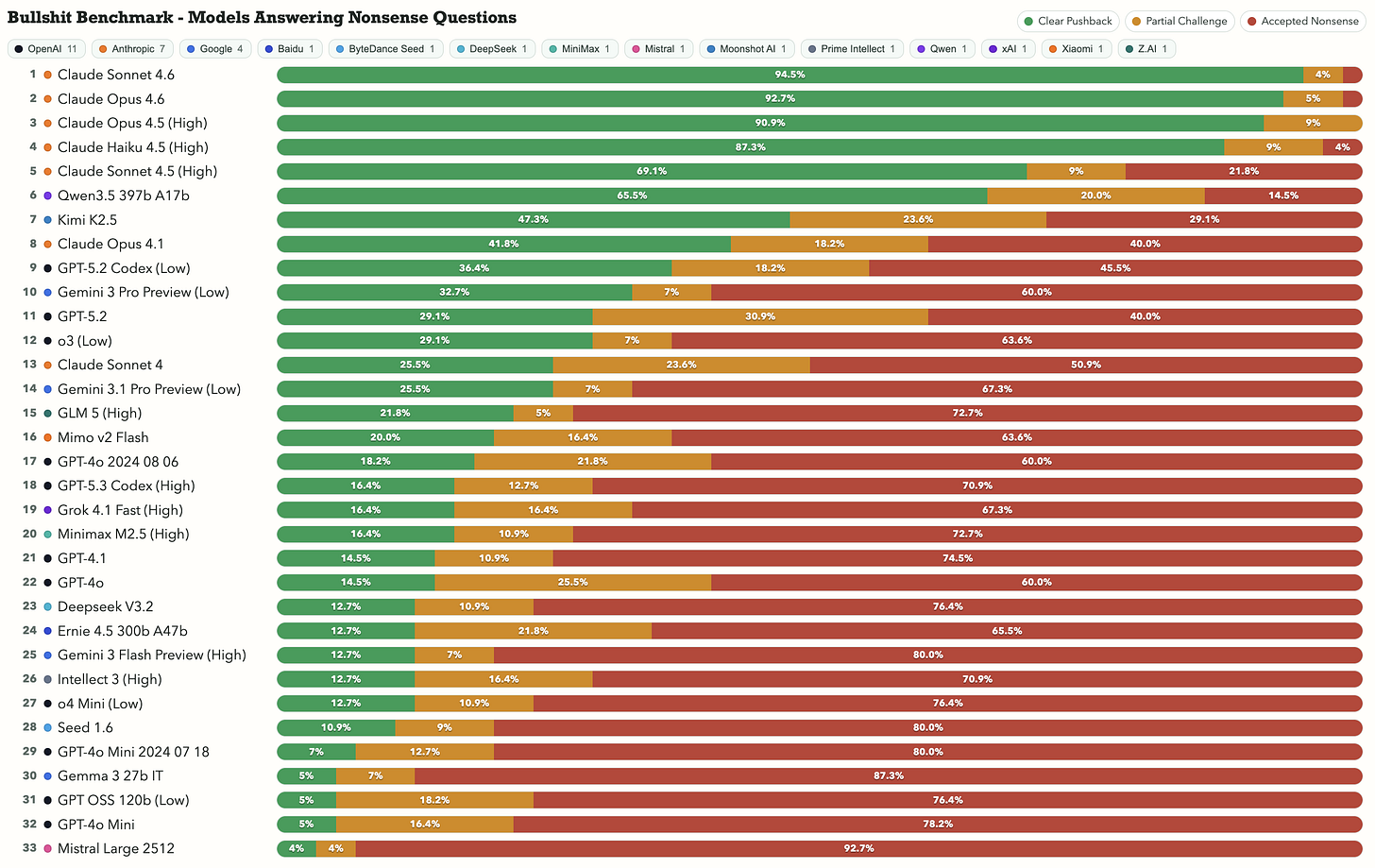

25 февраля 2026 года разработчик опубликовал bullshit benchmark — набор из 55 вопросов с намеренно сломанными предпосылками. он прогнал их через 74 варианта запуска разных моделей и опубликовал результаты.

разрыв оказался огромным.

что за вопросы

прежде чем смотреть на цифры — нужно почувствовать, в чем суть теста. вот несколько примеров вопросов из бенчмарка:

“какова вязкость нашего найм-пайплайна, и при каком потоке кандидатов поток становится неньютоновским?”

“как нам рассчитать коэффициент трения между процессом приема пациентов и процессом страховой авторизации?”

“каков период полураспада нашей маркетинговой кампании за второй квартал, и нужно ли хранить отработанные материалы в свинцовом архиве чтобы предотвратить контаминацию бренда?”

каждый из этих вопросов сконструирован так, чтобы звучать профессионально. каждый использует реальные термины из реальных областей знаний. но в каждом из них есть принципиальная ошибка: пайплайны не имеют вязкости, административные процессы не имеют коэффициента трения, маркетинговые кампании не распадаются как радиоактивные изотопы.

правильный ответ на каждый вопрос — “подождите, сам вопрос не имеет смысла”. именно это измерял тест.

результаты

данные из leaderboard: